Pamatujete si na dobu, kdy jsme museli ručně kontrolovat každý podezřelý článek nebo tweet? Bylo to vyčerpávající a často neúčinné. Dnes se situace dramaticky mění díky nástrojům jako ChatGPT, což je pokročilý jazykový model od společnosti OpenAI, který dokáže analyzovat texty v reálném čase a identifikovat známky manipulace. Propaganda už není jen otázkou skrytých motivů; stala se sofistikovanou hrou algoritmů a psychologie. A právě zde přichází na scénu AI.

Není to o tom, že by roboti náhle získali politická přesvědčení. Jde o to, že umělá inteligence dokáže rozpoznat vzorce, které lidské oko přehlédne. Změnila se hra. Detekce propagandy přestává být manuální prací fakt-checkerů a stává se automatizovaným procesem řízeným daty. Pojďme se podívat, co to pro nás znamená a jak to funguje ve skutečnosti.

Proč staré metody selhávají

Dlouho jsme spoléhali na jednoduchá pravidla. Hledali jsme velká písmena, vykřovníky nebo zjevně lživá tvrzení. To ale dnes nestačí. Moderní propaganda je jemná. Používá techniky jako gaslighting (manipulace vnímání reality) nebo straw man argument (vyvrácení zkresleného protistranického názoru). Lidé jsou unavení a jejich pozornost je limitovaný zdroj.

Když čteme sto komentářů denně, náš mozek prostě nedokáže zachytit subtilní posun v tónu nebo logickou chybu v každém jednotlivém příspěvku. Zde nastupuje NLP (Natural Language Processing), tedy zpracování přirozeného jazyka. Tato technologie umožňuje strojům "číst" texty tak, jak to děláme my, ale mnohem rychleji a bez emocí, které mohou vést k omylu.

Jak ChatGPT rozpozná manipulaci

ChatGPT nefunguje jako slovník pravdivosti. Neexistuje databáze, kde by byl uložen každý možný lživý výrok. Místo toho využívá kontext a pravděpodobnost. Model byl trénován na obrovském množství textových dat z internetu, knih, článků a diskusí. Díky tomu „ví“, jak vypadá objektivní informace versus emocionálně nabitá rétorika.

- Analýza sentimentu: AI dokáže detekovat nadměrné používání emotivních slov, která mají cílem vyvolat strach, hněv nebo euforii místo racionálního uvažování.

- Logická konzistence: Nástroj kontroluje, zda argumenty dává smysl a zda neodporují sobě samým v rámci daného textu.

- Identifikace bias: Umí rozpoznat jednostranné prezentace faktů, které ignorují alternativní pohledy, což je klasickým znakem propagandistického obsahu.

Představte si, že dostanete e-mail s nabídkou, která zní příliš dobře na to, aby byla pravda. Váš zdravý rozum vám řekne, abyste si hlídali záda. ChatGPT tento „zdravý rozum“ simuluje algoritmem. Když mu zadáte podezřelý text, on ho rozebere a ukáže vám místa, kde je autor pravděpodobně manipulační.

Rolové hry a simulace: Trénink pro média

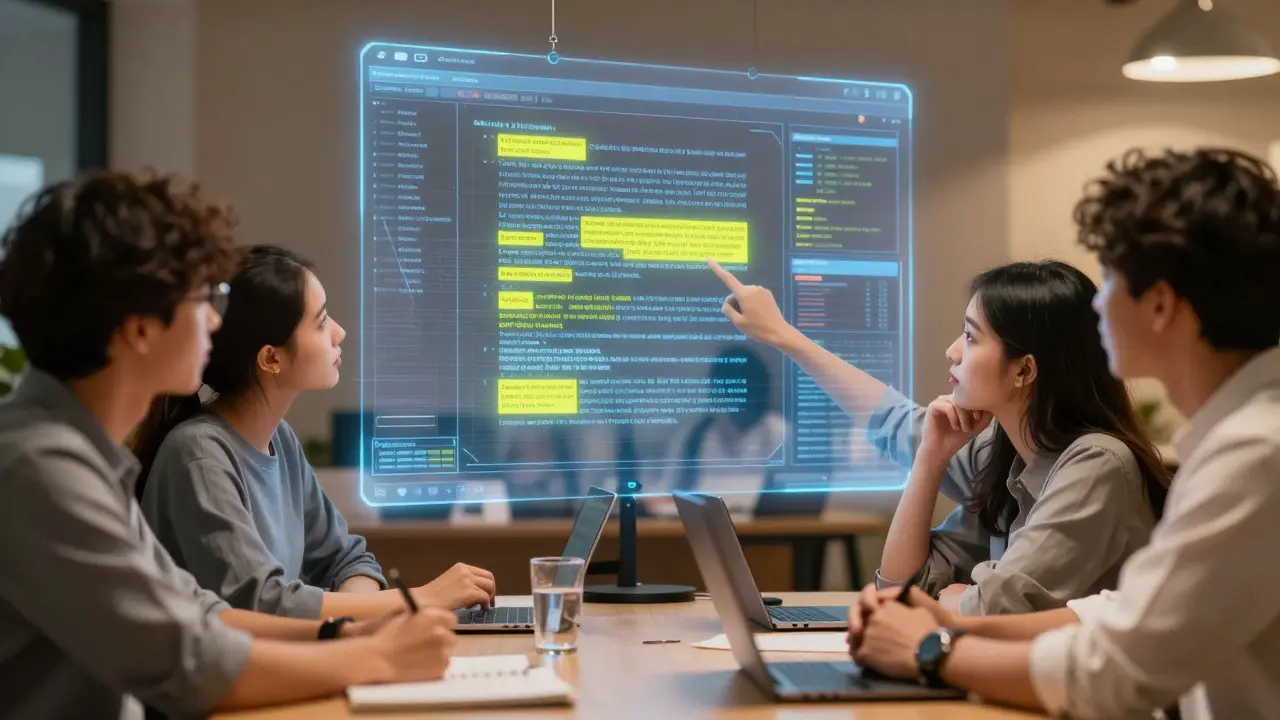

Jednou z nejzajímavějších aplikací této technologie je její použití při školení novinářů a studentů. Media literacy (mediální gramotnost) se stává klíčovou dovedností 21. století. Školy a univerzity začínají využívat AI k simulaci různých scénářů.

Student může zadat téma, například „změna klimatu“, a požádat ChatGPT, aby mu vygeneroval tři různé verze článku: jednu objektivní, jednu lehce zkreslenou a jednu otevřeně propagandistickou. Porovnáním těchto textů se učí rozpoznat nuance. Učí se vidět, jak se stejná fakta mohou použít k odlišným účelům. Tento přístup je mnohem efektivnější než pouhé přednášení teorie.

Tato metoda pomáhá budovat imunitu proti dezinformacím. Pokud víte, jak vypadá past, je méně pravděpodobné, že do ní spadnete. Je to podobné jako očkování - malé dávky expozice vám pomáhají vytvořit obranné mechanismy.

Ethické pasti a rizika falešných pozitiv

Zní to jako utopie, že ano? Bohužel, realita je složitější. Bias v datech je největším nepřítelem spravedlivé detekce. Pokud byl model trénován převážně na textech z určité kulturní nebo politické sféry, může označit legitimní názor za propagandu jen proto, že se liší od normy, kterou zná.

Představte si situaci, kdy aktivista píše vášnivý dopis o sociální nespravedlnosti. Emoce jsou součástí jeho sdělení. AI by mohla tento text označit za „manipulativní“ kvůli vysokému sentimentu, i když jde o upřímné svědectví. To vede k tzv. falešným pozitivům. Když systém často chybuje, lidé mu přestanou věřit a začnou ho ignorovat.

Dalším rizikem je cenzura. Kdo rozhodne, co je propaganda? Pokud bude tato technologie nasazena vládami nebo velkými technologickými společnostmi bez transparentních pravidel, hrozí, že se stane nástrojem tlumení opozice nebo neoblíbených názorů. Musíme si uvědomit, že neutralita stroje je iluze. Stroje odrážejí své tvůrce.

| Vlastnost | Výhoda | Nevýhoda/Riziko |

|---|---|---|

| Rychlost analýzy | Zpracování tisíců textů za sekundu | Možnost přehlédnout kontext specifický pro kulturu |

| Objektivita | Žádné osobní emoce ani únavu | Bias v trénovacích datech může zkreslit výsledky |

| Hledání vzorců | Rozpoznání složité logické chyby | Falešné pozitivy u kreativního nebo ironického psaní |

| Měřítko | Monitorování celých platforem najednou | Riziko masové cenzury a potlačení svobody projevu |

Lidský faktor: Poslední bariéra

Ať je technologie sebelepší, nemůže nahradit lidský soud. Fakt-checking zůstává nezbytnou součástí procesu. AI nám může dát varovný signál: "Tento text vypadá podezřele." Ale finální rozhodnutí, zda jde o lež, satiru nebo legitimní kritiku, musí udělat člověk.

Nejefektivnější přístup je hybridní. Myšlenka zní: AI filtruje šum a upozorňuje na potenciální hrozby, lidé pak provádějí hloubkovou analýzu. Tím šetříme čas a zároveň udržujeme kvalitu. Bez lidí bychom riskovali automatizované tresty za obsah, který byl pouze špatně pochopen strojem.

Je důležité, aby uživatelé chápali limity těchto nástrojů. Neměli bychom slepě věřit každému červenému tričku, které nám AI ukáže. Měli bychom se ptát: Proč to tak říká? Co za tím stojí? Jaká data byla použita?

Budoucnost: Od detekce k prevenci

Současné nástroje reagují na problém až po jeho vzniku. Budoucnost ale směřuje k preventivním mechanismům. Představte si editor, který vás v reálném čase upozorní, pokud píšete způsobem, který připomíná známé propagandistické techniky. Nebo platformu, která automaticky zpomalí šíření obsahu, který byl identifikován jako vysoce rizikový, dokud nebude ověřen lidmi.

Deepfake detekce se také propojuje s textovou analýzou. Když video obsahuje hluboké padělky, často doprovází i manipulativní textový popis. Komplexní systémy budou kombinovat vizuální i textové signály pro vyšší přesnost.

Toto není konec příběhu, ale začátek nové fáze. Musíme se naučit žít s těmito nástroji moudře. Technologie nám dává sílu, ale odpovědnost za její použití stále leží na našich ramenou. Cílem není vytvořit svět bez konfliktů názorů, ale svět, kde jsou tyto konflikty řešeny fakty, nikoliv manipulací.

Může ChatGPT zcela nahradit lidi v detekci propagandy?

Ne, nemůže. Ačkoli AI exceluje v rychlosti a hledání vzorců, chybí jí schopnost plně pochopit kulturnní kontext, ironii a nuance lidské komunikace. Lidský faktor je nezbytný pro finální rozhodování a vyhýbání se falešným pozitivům.

Jak poznám, že mi AI ukazuje falešné pozitivum?

Falešné pozitivum nastane, když AI označí legitimní text za manipulativní. Často se to stává u textů s silnými emocemi, satirou nebo kreativním psaním. Vždy si měli ověřit kontext a zvážit, zda nemá autor oprávněný důvod používat emotivní jazyk.

Je bezpečné používat veřejné AI nástroje pro analýzu citlivých textů?

Obecně ano, ale je třeba dávat pozor na soukromí. Veřejné modely mohou data používat k dalšímu tréninku. Pro citlivé nebo důvěrné dokumenty je lepší používat privátní instance AI nebo nástroje určené pro podnikání, které garantují ochranu dat.

Mohou propagandisté obejít detekci pomocí AI?

Ano, je to průběžný boj. Propagandisté se učí používat AI k generování textů, které obcházejí detektory. Proto je nutné neustále aktualizovat modely a kombinovat technologické řešení s lidským dohledem.

Co je to bias v trénovacích datech a proč je problematický?

Bias v datech znamená, že AI se učí z informací, které nejsou reprezentativní pro celou populaci. Pokud jsou data zkreslená směrem k jedné politické skupině nebo kultuře, AI může nespravedlivě označit jiné názory za propagandu. To ohrožuje neutrálnost systému.